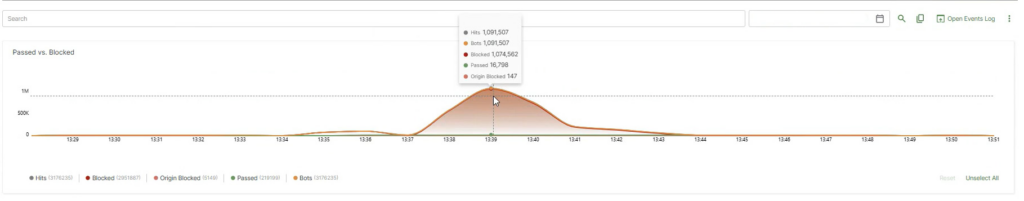

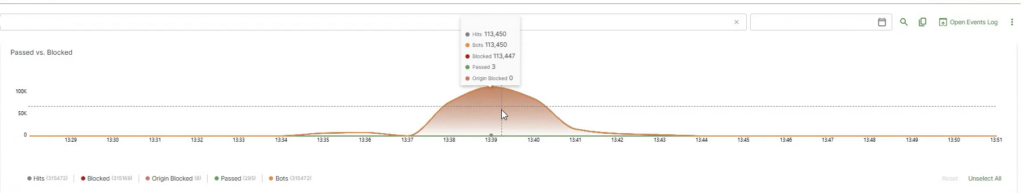

In unserem aktuellen Cyber-Insight schauen wir uns eine politisch motivierte DDoS-Attacke auf ein Rüstungsunternehmen an. Es war ein Layer-7-Angriff, kein klassischer volumetrischer Flood auf Netzwerkebene, sondern gezielter Druck auf die Applikationsschicht. Jeder Request muss von der WAF bewertet werden – Rate Limiting, Session-Tracking, Fingerprinting. Das kostet Rechenzeit auf der Verteidigungsseite, nicht nur Bandbreite.

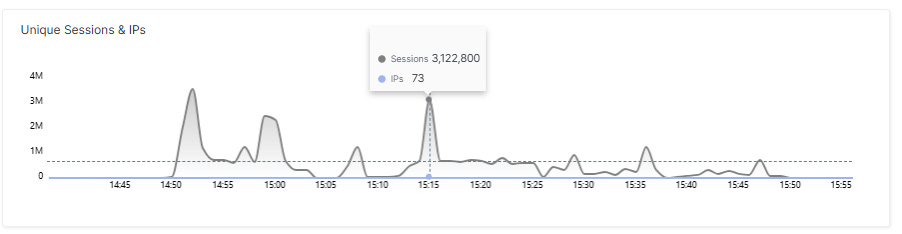

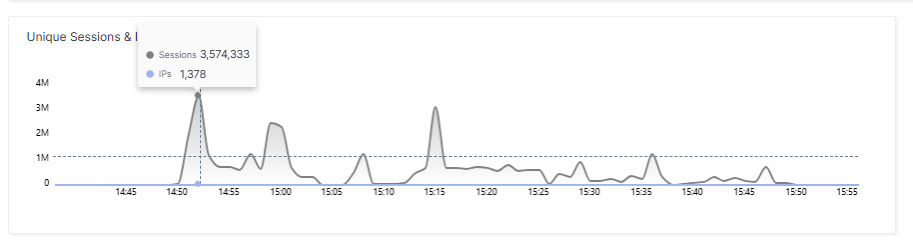

73 IPs, drei Millionen Sessions – das ist kein IoT-Botnetz

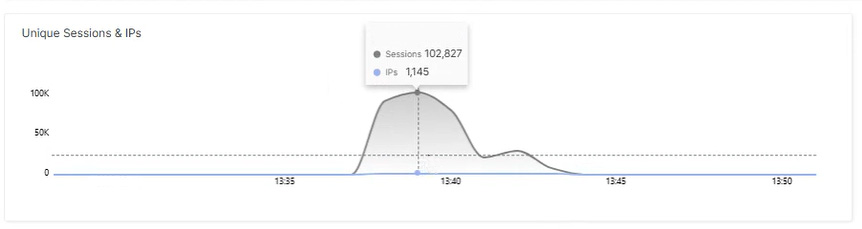

Klassische volumetrische DDoS-Angriffe setzen auf eine breite Streuung: Tausende kompromittierter Endgeräte – Router, Kameras, NAS-Systeme – senden gleichzeitig Anfragen. Hier war es anders. Die Angriffslast wurde auf eine kleine Zahl von IP-Adressen verteilt, von denen einzelne mit einer enormen Sessionrate arbeiteten. Eine einzige IP-Adresse hat 17 Millionen Requests geliefert. Nur 73 IP-Adressen haben gemeinsam über drei Millionen parallele Sessions geöffnet.

Ein IoT-Gerät hat einfach nicht die nötige CPU-Leistung für solche Lasten. Hier sieht es nach gemieteten Cloud-Ressourcen aus: hohe Rechenleistung, wenige IPs, maximale Request-Rate pro Knoten.

Die ASN-Analyse der angreifenden IP-Adressen hat bestätigt, was wir schon vermutet haben: Ein Großteil des Traffics – über 50 Millionen Requests – lassen sich Cloud-Infrastrukturen zuordnen. Darunter sind bekannte Hyperscaler und große CDN-Anbieter. Das kann bedeuten, dass der Angreifer entweder Cloud-Instanzen kompromittiert oder diese direkt gebucht hat. Vielleicht über anonyme Zahlungswege oder gestohlene Accounts.

Das führt auch zur Frage: Wer hat Zugang zu diesen Ressourcen und wie?

Geopolitischer Kontext: Wer ist dazu in der Lage – und warum?

Der Angriff fand während des aktiven Konflikts zwischen Israel und dem Iran statt. Diese Kombination legt eine politisch motivierte Urheberschaft nahe, auch wenn eine direkte Zuordnung nicht möglich ist.

Was die Analyse jedoch erschwert, ist die Tatsache, dass der iranische Staat während des Konflikts den Internetzugang stark eingeschränkt hat. Das bedeutet: Entweder handelt es sich um außerhalb Irans operierende, staatlich affiliierte Akteure oder um Proxy-Gruppen, die im Auftrag handeln und über entsprechende Infrastrukturzugänge verfügen. Beides setzt eine gewisse organisatorische Reife voraus.

Cloud-Kapazität ist günstig, anonym buchbar und technisch schlagkräftig. Ein vergleichbares IoT-Botnetz aufzubauen, wäre um ein Vielfaches aufwändiger und deutlich leichter zu blockieren. Daher sind verschiedene Szenarien denkbar.

Erfahren Sie mehr über eine einfach zu implementierende und äußerst effektive WAAP-Lösung.

Alles aus einer Hand und auf Wunsch als vollständig verwalteter Service.

Angriffstechnik: Simpel, aber skaliert

Auf den ersten Blick wirkten die User-Agents der angreifenden Clients divers: verschiedene Browser-Strings, unterschiedliche Versionen. Bei näherer Analyse zeigte sich jedoch ein eindeutiges Muster. Es handelte sich um algorithmisch generierte Strings, bei denen lediglich die Versionsnummer des Browser-Identifiers inkrementiert wurde. Es handelt sich also nicht um ein echtes Botnet-Diversity-Profil, sondern um ein einfaches Skript. Das reicht aus, um oberflächliche User-Agent-Filter zu umgehen, hält aber einer tieferen Verhaltensanalyse nicht stand.

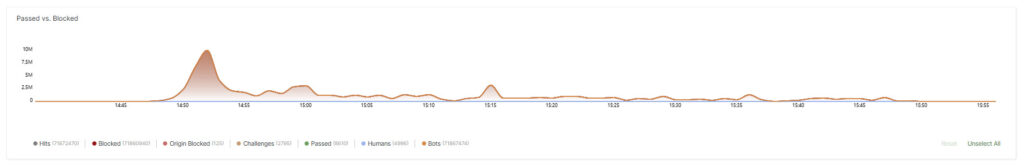

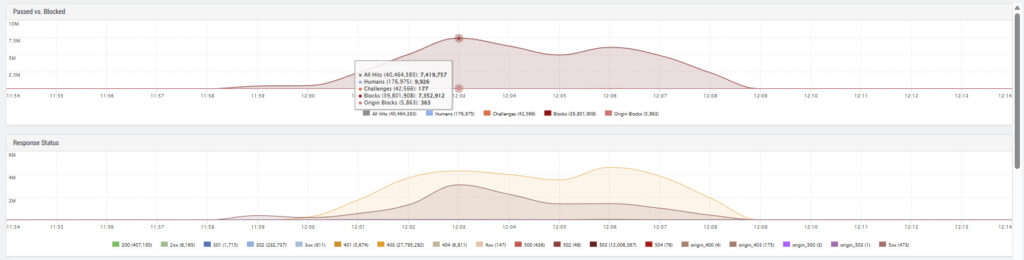

Interessant war auch die Dynamik des Angriffsverlaufs. Nach dem initialen Peak mit rund neun Millionen Requests pro Minute flachte das Volumen schrittweise ab. Dabei variierte die Zahl aktiver IP-Adressen und offener Sessions stark, teilweise zwischen über 1.300 und unter 50 innerhalb kurzer Zeitfenster. Dies deutet auf ein aktives Ressourcen-Management des Angreifers hin. Botnet-Nodes wurden zu- und abgeschaltet, möglicherweise, um die Kosten zu steuern oder die Angriffssignatur zu variieren.

Nachdem nach einer Stunde klar war, dass die Zielinfrastruktur standhielt, reduzierte der Angreifer schrittweise die Ressourcen und stellte den Angriff schließlich ein. DDoS ist heute eben auch auf Angreiferseite eine Kosten-Nutzen-Rechnung.

Was bedeutet das für Verteidiger?

Die Attacke veranschaulicht eine strukturelle Verschiebung in der Bedrohungslandschaft. Cloud-Ressourcen demokratisieren nicht nur Innovation, sondern auch Angriffsfähigkeiten. Wer heute über das nötige Budget und Grundwissen verfügt, kann einen Angriff dieser Größenordnung ohne eigene Hardware initiieren.

Fest steht: Ein Angreifer, der über 50 Millionen Requests aus westlichen Cloud-Segmenten orchestrieren kann, verfügt über operative Reife. Die Abwehr solcher Angriffe erfordert mehr als einfaches Rate Limiting. Benötigt werden verhaltensbasierte Analyse, ASN-Reputationsdaten und die Fähigkeit, Sessions auf Layer-7-Ebene zu korrelieren, statt nur einzelne IP-Adressen zu sperren.

Wer DDoS-Schutz nur auf Netzwerkebene denkt, ist auf Angriffe dieser Art nicht vorbereitet. Die Bedrohung hat sich von der Bandbreite zur Applikationslogik und von IoT-Botnetzen zu Cloud-nativen Angriffsinfrastrukturen verlagert. Und die nächste Attacke dieser Klasse kommt nicht aus einem Keller. Sie kommt aus einer „Availability Zone“ in Frankfurt, London oder New York.

Ist Ihre Applikationsebene auf Cyberangriffe dieser Größenordnung vorbereitet? Schauen Sie sich gemeinsam mit einem unserer Experten Ihre kritischen Webservices und Assets an. Kontaktieren Sie uns jederzeit für ein tiefergehendes Gespräch.

Wenn Ihr Netzwerk online ist und Umsatz generiert, ist es ein potenzielles Ziel. Das ist keine Übertreibung, sondern die Realität des modernen Internets. Und wenn Sie aktuell auf einen Standard-Transitanbieter mit einem aufgesetzten DDoS-Schutz setzen, besteht die Möglichkeit, dass Ihr Verteidigung eine Lücke hat, die Sie bisher noch nicht erkannt haben.

Dieser Artikel erklärt, was Link11 Clean Transit ist, wie es funktioniert, für wen es entwickelt wurde und warum die Art und Weise, wie die meisten Netzwerke heute geschützt werden, sie anfälliger macht als ihre Betreiber erkennen.

Das Problem mit der heutigen Angriffslage

Die meisten Netzwerke sind nach demselben Prinzip aufgebaut: IP-Transit wird bei einem Carrier eingekauft, der Konnektivität zum Internet bereitstellt. Separat dazu wird entweder ein DDoS-Mitigation-Dienst hinzugekauft oder man verlässt sich auf den eingeschränkten Schutz, den der Transitanbieter mitliefert. Wenn ein Angriff eintrifft, wird der Traffic zu einem Scrubbing-Center umgeleitet, bereinigt und dann zurückgeleitet.

Jahrelang hat das gut genug funktioniert. Angriffe waren groß, aber die Reaktionszeit reichte aus. Das Problem ist, dass sich Angriffe grundlegend verändert haben, die traditionelle Architektur jedoch nicht.

DDoS-Attacken sind 2025 um 121 Prozent gewachsen und erreichten zum Jahresende einen Durchschnitt von 5.376 automatisch abgewehrten Angriffen pro Stunde. Der größte einzelne Angriff in diesem Jahr erreichte einen Peak von 31,4 Tbps und dauerte 35 Sekunden. Das ist kein Tippfehler. Der größte jemals öffentlich dokumentierte DDoS-Angriff war vorbei, bevor die meisten automatisierten Systeme ihre Reaktion abgeschlossen hätten. Insgesamt wurden 2025 weltweit 47,1 Millionen DDoS-Angriffe verzeichnet. Das entspricht mehr als einem Angriff pro Sekunde, jeden Tag des Jahres.

Zwei technische Entwicklungen treiben dieses Wachstum an. Erstens verfügen groß angelegte IoT-Botnets inzwischen auch Angreifer mit geringen technischen Kenntnissen über Zugang zu enormen Trafficvolumen. Das Aisuru-Kimwolf-Botnet, das für viele der größten Angriffe im Herbst 2025 verantwortlich war, bestand aus schätzungsweise einer bis vier Millionen kompromittierten Android-TV-Geräten und war in der Lage, auf Abruf hyper-volumetrische Floods zu erzeugen.

Zweitens verteilen Carpet-Bombing-Angriffe den Traffic über ganze CIDR-Blöcke statt einzelne IP-Adressen. Das hebelt per-IP-Erkennungsschwellenwerte und Rate-Limiting-Regeln aus, weil keine einzelne Adresse einen Trigger-Punkt überschreitet, auch wenn das Subnetz als Ganzes überflutet wird. Mitigation-Systeme, die auf Einzelziel-Basis arbeiten, lösen nicht aus, bis das Muster auf Präfix-Ebene erkannt wird. Zu diesem Zeitpunkt ist oft schon erheblicher Schaden entstanden.

Warum Overlay-Mitigation bei schnellen, großen Angriffen versagt

Das Kernproblem bei aufgesetzter DDoS-Mitigation ist die Reaktionskette. Wenn die Anomalieerkennung anschlägt, läuft der Standardprozess so ab: Angriffssignatur erkennen, Traffic per BGP-Announcement zu einem Scrubbing-Center umleiten, Traffic bereinigen, sauberen Traffic zurückleiten. Jeder dieser Schritte kostet Zeit. Unter realistischen Bedingungen dauert der gesamte Erkennungs- und Mitigations-Zyklus zwischen 10 und 30 Sekunden.

Wenn der größte dokumentierte Angriff bei 31,4 Tbps peaked und in 35 Sekunden vollständig abgeschlossen ist, ist ein Aktivierungsfenster von 10 bis 30 Sekunden keine Kleinigkeit. Es ist eine Lücke, die den Großteil oder die gesamte Angriffsdauer abdeckt. Das Mitigation-Layer war für diese Art von Ereignis schlicht nicht ausgelegt, und es gibt keine Konfigurationsänderung, die das Problem schließt, weil die Verzögerung der Architektur inhärent ist.

Kurzzeit-Angriffe werden auch zunehmend als bewusste Technik eingesetzt. Angreifer können Uplinks sättigen, Connection-State-Tabellen auf Stateful-Devices erschöpfen oder SLA-Verletzungen mit Floods auslösen, die unter einer Minute dauern und verschwinden, bevor eine automatisierte Reaktion Zeit hatte zu greifen. Das ist besonders schädlich für Dienste, bei denen selbst kurze Nichtverfügbarkeit direkte betriebliche Konsequenzen hat: Live-Event-Streaming, Finanzhandel, Echtzeit-Kommunikation und Online-Gaming.

Wenn Overlay-Mitigation vollständig überlastet ist, fällt der Fallback der meisten Transitanbieter auf BGP-Blackhole-Routing zurück. Eine Null-Route wird für das angegriffene Präfix propagiert, was dazu führt, dass der gesamte Traffic für diese Adressen bereits im Upstream verworfen wird. Angriffstraffic kommt nicht mehr beim Kunden an, aber legitimer Traffic auch nicht. Das Präfix verschwindet aus der Routing-Tabelle. Der Dienst des Kunden ist offline. Das schützt die eigene Infrastruktur des Carriers auf Kosten der Verfügbarkeit des Kunden.

Die finanziellen Folgen sind messbar: Laut dem ITIC 2024 Hourly Cost of Downtime Survey berichten mehr als 90 Prozent der mittelgroßen und großen Unternehmen, dass eine einzelne Stunde Ausfall über 300.000 USD kostet. Bei rund 41 Prozent dieser Unternehmen liegt die Zahl bei über einer Million USD pro Stunde. Für die größten Unternehmen in Sektoren wie Banking, Finanzdienstleistungen und Fertigung überstiegen die durchschnittlichen stündlichen Ausfallkosten laut ITIC die Marke von fünf Millionen USD.

Erfahren Sie mehr über Clean Transit von Link11.

Always-on DDoS-Abwehr direkt in Ihren Transit integriert. Kein separates Schutztool, keine Verzögerung bei der Aktivierung.

Was ist Clean Transit?

Clean Transit ist ein sicherheitsnatives IP-Transit-Produkt. Es ist kein aufgesetztes Mitigation-Layer und sitzt nicht neben dem bestehenden Transit. Es ersetzt den Upstream-Transit vollständig, mit DDoS-Scrubbing direkt in der Data Plane.

Der entscheidende architektonische Unterschied: Scrubbing ist immer aktiv. Es gibt keine Erkennungsphase, keinen Umleitungsschritt und keinen Aktivierungsverzug. Jedes eingehende Byte durchläuft die Scrubbing-Infrastruktur von Link11, bevor es an das Kundennetzwerk weitergeleitet wird. Das Filtering ist kontinuierlich und läuft mit Leitungsrate, unabhängig davon, ob gerade ein Angriff stattfindet. Sauberer Traffic ist das Einzige, was ausgeliefert wird. Das ist das Produkt.

Das eliminiert das oben beschriebene Timing-Problem vollständig. Ein 35-Sekunden-Angriff, der bei 31 Tbps peaked, wird identisch behandelt wie normaler Traffic an einem ruhigen Tag. Die Infrastruktur muss nicht erkennen, klassifizieren und reagieren, weil sie niemals aufhört zu filtern.

Es gibt auch keinen Blackhole-Fallback. Da Scrubbing dauerhaft und auf Infrastrukturebene betrieben wird, gibt es kein Szenario, in dem Link11 das Präfix eines Kunden zurückziehen müsste, um das eigene Netz zu schützen. Das Backbone ist darauf ausgelegt, Multi-Terabit-Angriffstraffic zu absorbieren, nicht ihn zu umgehen.

Wie Clean Transit technisch funktioniert

Die Integration in das bestehende Netzwerk eines Kunden erfolgt vollständig über BGP. Kunden announcen ihre IP-Präfixe gegenüber der ASN von Link11 über Standard-BGP-Sessions. Sämtlicher Traffic, der für diese Präfixe bestimmt ist, wird dann an den Ingress-Punkten abgefangen, durch die Scrubbing-Pipeline geleitet und als sauberer Traffic weitergeleitet.

Die Scrubbing-Pipeline operiert gleichzeitig über alle Peering- und Transit-Ports. Auf der Kundenseite ist kein Traffic-Steering erforderlich und es sind keine Änderungen an der internen Routing-Architektur notwendig. Der Kunde empfängt sauberen Traffic über die vereinbarte Delivery-Methode.

Return-Traffic, also ausgehend aus dem Kundennetzwerk, wird über die Interconnect-Methode zugestellt, die zur Topologie des Kunden passt. Verfügbare Optionen sind ein physischer Cross-Connect in einem Colocation-Facility, ein VLAN-Handoff an einem Internet Exchange Point wie DE-CIX, AMS-IX oder LINX, Remote Peering über Route Server oder ein GRE- bzw. IPsec-Tunnel für Kunden, die keine physische Übergabe einrichten können. Jede dieser Optionen führt die vollständige BGP-Routing-Tabelle, was Kunden optimierte Routen über die Upstream-Carrier und Peering-Partner von Link11 gibt.

Zum Produkt gehört außerdem ein Echtzeit-Monitoring-Dashboard mit Live-Traffic-Analysen, Netflow-Daten und Angriffsberichten. Das gibt Betreibern vollständige Transparenz über den eingehenden Traffic zu jedem Zeitpunkt, einschließlich während eines aktiven Angriffs, ohne dass separates Tooling oder manuelle Eingriffe zur Berichtsgenerierung notwendig sind.

Aus DSGVO- und Datensouveränitätsperspektive betreibt Link11 europäische Infrastruktur und verarbeitet Traffic innerhalb des EU-Rechtsrahmens. Für Betreiber in Deutschland, Österreich, der Schweiz oder anderswo in der EU mit Datenhaltungsanforderungen ist das sowohl für Compliance als auch für vertragliche Verpflichtungen gegenüber Kunden relevant.

Für wen Clean Transit entwickelt wurde

Clean Transit richtet sich an Netzwerkbetreiber, deren Geschäft von Verfügbarkeit abhängt und die entweder die Kosten eines Ausfalls nicht tragen können oder keine eigene Scrubbing-Infrastruktur aufbauen und betreiben wollen.

Hosting-Provider tragen typischerweise DDoS-Risiko im Auftrag ihrer Kunden. Ein Angriff auf einen Mandanten kann die gemeinsam genutzte Upstream-Kapazität beeinträchtigen und andere Kunden auf derselben Infrastruktur treffen. Clean Transit verlagert den Schutz auf die Upstream-Ebene, sodass das Scrubbing stattfindet, bevor Traffic überhaupt das Hosting-Netzwerk erreicht.

Regionale ISPs leiten Traffic für ihre Downstream-Teilnehmer. Ein erfolgreicher Angriff auf deren Upstream führt zu Konnektivitätsverlust für den gesamten Kundenstamm. Clean Transit bietet Upstream-Schutz, ohne dass der ISP eine eigene Scrubbing-Infrastruktur betreiben oder separate Mitigation-Verträge verhandeln muss.

Gaming-Plattformen gehören zu den meistangegriffenen Diensten im Internet und reagieren besonders empfindlich auf die Latenz, die durch Traffic-Umleitung entsteht. Standardmäßige Mitigation-Ansätze, die Traffic durch ein Scrubbing-Center umleiten, erhöhen die Round-Trip-Time auch dann, wenn sie korrekt funktionieren. Da Clean Transit direkt im Transit-Layer filtert, ohne Umleitung, entsteht kein zusätzlicher Latenzpfad für legitimen Traffic.

SaaS- und Cloud-Provider verkaufen Verfügbarkeit als Teil ihres Produkts. SLA-Verpflichtungen, Churn-Risiko und Reputationsschäden folgen direkt aus einem Ausfall. Diese Betreiber sehen sich häufig Angriffen auf mehrere Präfixe gleichzeitig ausgesetzt, was Carpet-Bombing-Techniken gezielt ausnutzen. Clean Transit schützt den gesamten Adressraum auf Upstream-Ebene.

Finanzdienstleister sind sowohl direkten Umsatzverlusten als auch regulatorischen Risiken durch Ausfallzeiten ausgesetzt. In manchen Jurisdiktionen sind Verfügbarkeitspflichten für bestimmte Finanzdienstleistungen regulatorisch verankert, sodass ein Ausfall nicht nur ein kommerzielles, sondern auch ein Compliance-Problem darstellt. Das 99,99-Prozent-SLA des Enterprise-Tiers ist auf diese Anforderungen ausgelegt.

E-Commerce-Betreiber werden häufig gezielt während der umsatzstärksten Zeiten angegriffen, weil der finanzielle Schaden dann am größten ist. Ein Mitigation-Service, der 20 Sekunden zum Aktivieren braucht, während ein Flash-Angriff auf einen Produkt-Launch oder ein Verkaufsevent abzielt, schützt möglicherweise nicht rechtzeitig. Always-on-Scrubbing eliminiert dieses Risiko.

Service-Tiers

Clean Transit ist in drei Tiers verfügbar. Die Preise entsprechen dem Niveau standard-mäßiger Mid-Tier-Transitanbieter. Das Argument für Clean Transit ist nicht ein niedrigerer Preis, sondern dass zum gleichen Preis Scrubbing auf Infrastrukturebene enthalten ist, statt als separater Dienst, den man verwalten und auf rechtzeitige Aktivierung hoffen muss.

Essential deckt 1 bis 10 Gbps Committed Bandwidth mit Burst auf 2x und einem 99,9-Prozent-SLA ab. Geeignet für regionale ISPs und kleinere Netzwerkbetreiber.

Professional deckt 10 bis 50 Gbps mit Burst auf 3x und einem 99,95-Prozent-SLA ab. Geeignet für Hosting-Provider und Gaming-Plattformen, bei denen Bandbreitenanforderungen höher und die Uptime direkt an Kundenverpflichtungen geknüpft ist.

Enterprise deckt 50 bis 100 Gbps und mehr mit Burst auf 5x und einem 99,99-Prozent-SLA ab. Geeignet für SaaS-Provider, Finanzdienstleister, Streaming-Plattformen und CDN-Betreiber, bei denen Ausfälle unmittelbare finanzielle und regulatorische Konsequenzen haben.

Alle Tiers beinhalten Always-on-Scrubbing, die vollständige BGP-Routing-Tabelle, alle verfügbaren Delivery-Optionen und Dashboard-Zugang. Volumenbasierte Preise sind für größere oder stufenweise Deployments verfügbar.

Was Clean Transit von herkömmlichen Lösungen unterscheidet

Am einfachsten lässt es sich so ausdrücken: Die meisten DDoS-Schutzprodukte werden aktiviert, wenn etwas schiefläuft. Clean Transit ist aktiv, bevor etwas schiefläuft, und bleibt aktiv, unabhängig davon, was passiert.

Bei einem Standard-Mitigation-Overlay hängt der Schutz davon ab, dass drei Dinge gleichzeitig funktionieren: Der Angriff wird schnell genug erkannt, die Traffic-Umleitung verursacht keine zu hohe Latenz, und die Scrubbing-Kapazität reicht für das Angriffsvolumen. Wenn auch nur eines davon nicht stimmt, versagt der Schutz. Bei Clean Transit existieren diese Variablen nicht in dieser Form. Es gibt keinen Erkennungsschritt, keine Umleitung und kein Kapazitätslimit, das nur im Angriffsfall gilt. Das Scrubbing läuft mit Leitungsrate, kontinuierlich.

Link11 hat sein Netzwerk für den Umgang mit großangelegten DDoS-Angriffen aufgebaut. Die Scrubbing-Infrastruktur, auf der Clean Transit basiert, ist dieselbe, die die Enterprise-Kunden von Link11 schützt. Clean Transit macht diese Kapazität als Wholesale-Transit-Produkt verfügbar. Kunden kaufen keine Absicherung von einem Unternehmen, das nachträglich Sicherheitsfunktionen auf ein Konnektivitätsprodukt aufgesetzt hat. Sie kaufen Konnektivität von einem Unternehmen, das das Netzwerk von Grund auf für die Absorption von Terabit-Angriffen gebaut hat.

Fazit

DDoS-Angriffe sind größer, schneller und leichter zu starten als je zuvor. Das herkömmliche Modell, Transit zu kaufen und Schutz obendrauf zu legen, wurde nicht für Angriffe in dieser Geschwindigkeit und Größenordnung entwickelt. Wenn Ihr Mitigation-Dienst einen Angriff erst erkennen muss, bevor er reagieren kann, wird es schwierig. Attacken sind heute konzipiert sind, dass sie in unter einer Minute ihre Lastspitze finden und danach teilweise genauso schnell vorbei sind, wie sie begonnen haben. Es existiert also ein Expositionsfenster, das sich durch Konfiguration allein nicht schließen lässt.

Clean Transit schließt dieses Fenster. Der Schutz ist in den Transit-Layer eingebaut. Jedes Paket wird gefiltert, bevor es Ihr Netzwerk erreicht. Kein Aktivierungsverzug, kein Blackhole-Fallback, kein separater Dienst, den man verwalten muss.

Wenn Sie Infrastruktur betreiben, bei der Ausfallzeiten Geld kosten, bei der Kunden merken, wenn Sie offline gehen, oder bei der Sie SLA- oder regulatorische Verpflichtungen einzuhalten haben, ist Clean Transit einen genaueren Blick wert. Link11 bietet eine technische Bewertung Ihres aktuellen Setups als Einstiegspunkt, ohne Verpflichtung.

Sollten Sie Fragen zur Technologie haben, stehen Ihnen unsere Cyberexperten gerne jederzeit zur Verfügung.

Jetzt kontaktieren >>

Nicht alle Angriffe sind spektakulär. Manche verlaufen eher unscheinbar, ohne dabei Rekordwerte bei Bandbreite oder Paketvolumen zu erreichen. So auch die folgende DDoS-Attacke: Auf den ersten Blick wirkt er eher unspektakulär, da das Volumen bei rund drei Millionen Requests lag. Im Vergleich zu groß angelegten DDoS-Kampagnen ist dies kein außergewöhnlicher Wert. Dennoch lohnt sich ein genauerer Blick auf die Struktur. Denn diese zeigt, wie Angreifer selbst mit begrenzten Mitteln versuchen, Webanwendungen gezielt zu stören.

Auffälliges Traffic-Muster: langsamer Anstieg, plötzlicher Peak

Der Traffic-Verlauf zeigte zunächst einen langsamen, kontinuierlichen Anstieg der Anfragen. Danach folgte ein einzelner, deutlich sichtbarer Peak. Im Gegensatz zu massiven volumetrischen Angriffen blieb das Gesamtvolumen jedoch moderat.

Charakteristisch war zudem, dass sich der Angriff ausschließlich auf die Root-Domain, also die Startseite der Website, konzentrierte und nicht auf spezifische Unterverzeichnisse oder API-Endpunkte. Solche Muster sind typisch für vereinfachte Botnet-Aktivitäten, bei denen keine gezielte Analyse von Anwendungspunkten erfolgt, sondern generische Anfragen an den Hauptendpunkt gesendet werden.

Geografische Einschränkung als Schutzmaßnahme

In diesem Fall war die bestehende Zugriffsbeschränkung ein wesentlicher Faktor: Für die betroffenen Domains war eine Regel aktiv, die nur Traffic aus bestimmten Regionen zuließ, wie etwa den USA und Europa. Anfragen aus anderen Ländern wurden automatisch blockiert. Ein großer Teil des Angriffsverkehrs stammte jedoch aus Ländern, die nicht auf der Whitelist standen, darunter China, Indien oder die Türkei. Diese Requests wurden unmittelbar verworfen.

Gleichzeitig wurde ein Teil des Traffics aus zugelassenen Ländern wie Deutschland blockiert. Die Ursache lag dabei nicht in der Geofilterung, sondern in anderen Schutzmechanismen wie dem Rate-Limiting.

Rate Limiting: Schutz vor zu vielen Anfragen

Rate-Limiting ist eine gängige Methode, um Webanwendungen abzusichern. Dabei wird festgelegt, wie viele Anfragen ein Client innerhalb eines bestimmten Zeitfensters stellen darf. Wird diese Schwelle von einer IP-Adresse überschritten, werden weitere Requests temporär blockiert.

Im vorliegenden Fall zeigte sich, dass ein Großteil der zugelassenen deutschen Anfragen aus genau diesem Grund abgewiesen wurde. Dies deutet darauf hin, dass die betreffenden IP-Adressen in kurzer Zeit ungewöhnlich viele Requests generierten. Ein typisches Muster für automatisierte Botanfragen.

GET-Request im Fokus

Zudem wurden auch HTTP-Anfragen mit der Methode GET blockiert. Das wirft zunächst Fragen auf, da GET die am häufigsten genutzte HTTP-Methode ist.

Um dies einzuordnen, lohnt sich ein kurzer Blick auf die Grundlagen des HTTP-Protokolls.

HTTP (Hypertext Transfer Protocol) definiert verschiedene Methoden, mit denen Clients (z. B. Browser) mit einem Webserver kommunizieren. Zu den wichtigsten zählen:

- GET: Ruft Informationen vom Server ab

- POST: Sendet Daten an den Server (z. B. Formulareingaben).

- PUT: Aktualisiert bestehende Ressourcen.

- DELETE: Löscht Ressourcen.

- HEAD: Fordert nur Header-Informationen an.

Die GET-Methode dient ausschließlich dazu, Informationen vom Server zu erhalten. Ein klassischer Seitenaufruf im Browser ist technisch gesehen ein GET-Request. Dabei werden keine Daten verändert oder gespeichert, sondern lediglich eine Ressource abgefragt.

Genau deshalb gilt GET grundsätzlich als „harmlos“: Über einen reinen GET-Request lassen sich keine Daten auf dem Server verändern oder direkt einschleusen. Injection-Angriffe zielen typischerweise auf Parameter oder andere Schwachstellen ab, nicht auf die Methode selbst.

Warum GET dennoch blockiert wird

Es kann sinnvoll sein, GET-Anfragen gezielt zu blockieren, wenn eine Anwendung diese nicht benötigt. In spezialisierten APIs oder Backend-Systemen, die ausschließlich POST-Anfragen erwarten, kann das Blockieren aller GET-Anfragen die Angriffsfläche reduzieren. Hier war ein solcher Filter aktiv. Alle GET-Anfragen wurden automatisch verworfen.

Da der beobachtete Angriff ausschließlich mit der GET-Methode arbeitete und nur die Root-Domain ansprach, wurde der Verkehr vollständig abgefangen. Es handelte sich also um eine einfache, massenhafte Nutzung der Standardmethode, um Serverressourcen zu binden.

Erfahren Sie mehr über eine einfach zu implementierende und äußerst effektive WAAP-Lösung.

Alles aus einer Hand und auf Wunsch als vollständig verwalteter Service.

Kleine Botnetze, reale Auswirkungen

Im Gegensatz zu großen Botnetzen handelte es sich um ein kleines Netz mit einer geringen Anzahl beteiligter IP-Adressen. Das bedeutet jedoch nicht, dass kein Risiko besteht.

Ob ein Angriff erfolgreich ist, hängt auch von der Zielinfrastruktur ab. Eine ressourcenintensive Webanwendung oder ein schlecht skalierter Server kann bereits durch moderate Request-Zahlen überlastet werden.

Besonders bei vielen gleichzeitigen Verbindungen oder der Generierung dynamischer Inhalte steigt die CPU- und Speicherbelastung schnell an. Solche Angriffe zielen auf Anwendungsebene. Sie versuchen, Serverressourcen durch viele HTTP-Anfragen zu binden.

GET-Anfragen sind alltäglich, weshalb sie nicht pauschal als bösartig klassifiziert werden können. Erst in Kombination mit Frequenz, Herkunft und Verhaltensmustern entsteht ein belastbares Bild. Der Vorfall verdeutlicht, dass nicht die Größe des Botnetzes, sondern die Wechselwirkung zwischen Angriffsstrategie und Zielarchitektur über das Risiko entscheidet.

Ein kleiner, sauber strukturierter Angriff kann dennoch Wirkung entfalten, insbesondere bei fehlenden Schutzmechanismen. In diesem Fall blieben sie wirksam.

Haben Sie Fragen zum Thema oder brauchen Informationen, wie Sie sich ideal auf solche Angriffe vorbereiten können?

Jetzt unsere Cyberexperten kontaktieren>>

Wenn ein Unternehmen Ziel eines Distributed Denial-of-Service (DDoS)-Angriffs wird, ist der erste Reflex oft, den vermeintlich schädlichen Traffic so schnell und rigoros wie möglich zu blockieren. Doch was passiert, wenn die Abwehrmaßnahmen über das Ziel hinausschießen und genau die Menschen aussperren, die man eigentlich bedienen möchte?

Wenn der Schutz zum Hindernis wird: False Positives in der DDoS-Abwehr

In der Cybersicherheit beschreibt ein „False Positive“ eine Situation, in der ein Schutzsystem völlig legitimen, harmlosen Datenverkehr irrtümlich als Bedrohung einstuft und abweist. Bei der DDoS-Mitigation kann dies geschehen, wenn ein Netzwerk plötzliche, aber echte Traffic-Spitzen verzeichnet, die zum Beispiel durch eine erfolgreiche Marketingkampagne, einen großen Produkt-Launch oder saisonale Events ausgelöst werden. Ein starr konfiguriertes Abwehrsystem registriert den rapiden Anstieg der Zugriffe, verwechselt den Ansturm der echten Kunden mit einer böswilligen Bot-Attacke und blockiert sie.

Das paradoxe Ergebnis: Die IT-Infrastruktur ist zwar geschützt, aber für einen Teil der eigentlichen Zielgruppe ist der Dienst aber dennoch offline. False Positives verursachen somit direkte Serviceunterbrechungen, frustrieren Kunden und können zu Umsatzeinbußen sowie Reputationsschäden führen.

Das False-Positive-Dilemma herkömmlicher Schutzsysteme

Viele klassische DDoS-Schutzsysteme verwenden noch immer ältere Methoden wie feste Regeln oder simples Rate-Limiting. Bei schnell ablaufenden Angriffen auf Layer 3 und Layer 4 oder plötzlichen Traffic-Spitzen stoßen diese starren Methoden jedoch schnell an ihre Grenzen.

Dieses Dilemma belastet nicht nur die Endnutzer, sondern auch die internen IT- und Sicherheitsteams enorm. Für Teams im Security Operations Center und Network Operations Center bedeutet lösen bereits Störungen bei einzelnen Nutzern zeitaufwendige Ursachenanalysen aus. Die Teams verbringen Stunden damit herauszufinden, ob Ausfälle durch Angriffe oder durch Fehlalarme verursacht wurden.

Erschwert wird diese Situation zusätzlich durch traditionelle „Black-Box“-Systeme, die Traffic filtern, ohne den Administratoren transparent und nachvollziehbar zu erklären, warum eine bestimmte Verbindung überhaupt blockiert wurde.

Erfahren Sie mehr über eine einfach zu implementierende und äußerst effektive WAAP-Lösung.

Alles aus einer Hand und auf Wunsch als vollständig verwalteter Service.

Der Weg in die Zukunft: Intelligente, verhaltensbasierte Mitigation

Um diesem branchenweiten Problem zu begegnen, sollte sich der Fokus der modernen Cybersicherheit zunehmend auf intelligente, verhaltensbasierte Analysen (Behavioral Analytics), gepaart mit adaptiven Engines, verlagern. Statt pauschal Datenverkehr zu drosseln, analysieren solche Systeme Live-Traffic-Muster mithilfe einer hochentwickelten verhaltensbasierten Erkennung und setzen auf eine granulare Per-Protokoll- und Per-Port-Filterung. Das bringt drei entscheidende Vorteile für moderne Netzwerkinfrastrukturen:

- Geringerer Bedarf für Manual Tuning durch adaptives Lernen: Eine Auto-Learning Mitigation Engine passt sich in Echtzeit an das normale Verhalten des Netzwerks an. Dadurch werden False Positives, die unnötige Ausfallzeiten verursachen, drastisch reduziert. Das aufwendige, fehleranfällige manuelle Anpassen von Schwellenwerten entfällt komplett, wodurch sich das Team wieder auf strategische Aufgaben fokussieren kann.

- Proaktiver, always-on Schutz für mehr Sicherheit und Kontrolle: Moderner DDoS-Schutz muss Angriffe stoppen, bevor sie die Netzwerkleistung oder die Verfügbarkeit von Diensten beeinträchtigen können. Ein proaktiver, always-on Schutz erkennt bösartigen Datenverkehr frühzeitig und wehrt ihn an der Quelle ab, bevor er den legitimen Datenverkehr stören kann. Dies Hilf Unternehmen, auch bei schnell ablaufenden Angriffen eine stabile Leistung, kontinuierliche Verfügbarkeit und volle Kontrolle aufrechtzuerhalten.

- Forensische Transparenz statt Black-Box: Wenn Traffic blockiert wird, brauchen Sicherheitsteams sofortige Klarheit. Eine moderne Abwehrarchitektur ersetzt die Black-Box durch forensische Sichtbarkeit in Echtzeit. Anhand von detaillierten Live-Dashboards, spezifischen „Reason Codes“ und Echtzeit-Logs können Security-Teams jederzeit exakt und auditsicher nachvollziehen, auf welcher Basis eine Mitigationsentscheidung getroffen wurde.

Die neue Ära der DDoS-Abwehr

In einer Zeit, in der Uptime gleichbedeutend mit Umsatz und Reputation ist, darf Cybersicherheit den Geschäftsbetrieb nicht behindern. Mit intelligenter Network DDoS-Mitigation müssen Unternehmen sich nicht mehr zwischen maximalem Schutz und optimaler User Experience entscheiden. Wer auf verhaltensbasierte, transparente und granulare Abwehrmechanismen setzt, stellt sicher, dass Netzwerke nicht nur vor Bedrohungen geschützt sind, sondern für legitime Nutzer jederzeit offen bleiben.

Was passiert, wenn man Cyberkriminellen ihr teuerstes Spielzeug wegnimmt? Sie werden wütend und greifen an. Als mutige Sicherheitsforscher beschlossen, über 500 Kommando-Server der berüchtigten IoT-Botnetze Kimwolf und Aisuru lahmzulegen, reagierten die Hacker prompt: Sie feuerten massive Rache-Attacken auf die Forscher ab, deren Datenpakete bis zum Rand mit wüsten, vulgären Beschimpfungen gefüllt waren.

Dies ist die Geschichte vom rasanten Aufstieg einer gigantischen Cyber-Bedrohung, einem florierenden kriminellen Geschäftsmodell und dem bizarren Katz-und-Maus-Spiel zwischen Forschern und wutentbrannten Hackern.

Die unsichtbare Armee: Was sind Kimwolf und Aisuru?

Alles begann im August 2024, als Sicherheitsexperten erstmals das Aisuru-Botnetz identifizierten. Kurz darauf trat sein „großer Bruder“ Kimwolf auf den Plan. Zusammen bildeten sie eine stark verflochtene, beispiellose Cyber-Bedrohung, die das Internet in den Jahren 2025 und 2026 in Atem hielt.

Die Botnetze machten sich eine eklatante Schwachstelle unserer modernen Welt zunutze: schlecht gesicherte Internet-of-Things (IoT)-Geräte. Von handelsüblichen Internet-Routern in heimischen Wohnzimmern bis hin zu unsicheren Überwachungskameras – die Schadsoftware kaperte alles, was nicht bei Drei auf den Bäumen war. In ihrer Hochphase umfasste das Netzwerk von Aisuru, Kimwolf und verwandten Netzen wie JackSkid mehr als 3 Millionen infizierte Geräte weltweit. Allein Kimwolf hatte rund 2 Millionen Systeme unter seine Kontrolle gebracht.

Ihre primäre Waffe? Sogenannte hyper-volumetrische DDoS-Angriffe. Die schiere Masse an Geräten ermöglichte eine Zerstörungskraft von nie dagewesenem Ausmaß. Während das Aisuru-Botnetz in seiner Laufzeit über 200.000 DDoS-Angriffsbefehle erteilte, sorgte Kimwolf mit mehr als 25.000 Befehlen für Chaos. Im Dezember 2025 zwangen sie gemeinsam ein riesiges Content Delivery Network in die Knie. Im Februar 2026 überfluteten sie gezielt das dezentrale Anonymisierungsnetzwerk I2P.

Das wahre Geschäftsmodell: Mehr als nur rohe Gewalt

Doch rohe DDoS-Gewalt war den Betreibern bald nicht mehr lukrativ genug. Sie erkannten, dass ein Netzwerk aus Millionen gekaperter Privat-Router eine viel wertvollere Ressource darstellt: Unauffälligkeit.

Die Hacker begannen, die infizierten Geräte in sogenannte „Residential Proxies“ umzuwandeln. Das Prinzip ist perfide: Wenn Cyberkriminelle Angriffe starten, leiten sie ihren Datenverkehr einfach durch den Router einer ahnungslosen Privatperson. Für die Sicherheitssysteme von Banken oder Online-Shops sieht es dann so aus, als käme die Anfrage von einem harmlosen Haushaltsanschluss.

Dieses Netzwerk befeuerte im Hintergrund eine gewaltige Welle an Online-Betrug, Web-Scraping und Credential Stuffing, dem massenhaften automatisierten Ausprobieren von gestohlenen Passwörtern. Sicherheitsforscher stellten fest, dass das systematische Scannen und Missbrauchen dieser Proxy-Netzwerke durch Kimwolf ein absolut beispielloses Ausmaß annahm und die Infrastruktur zeitweise die am stärksten anvisierte Domain weltweit war.

Der Krieg im Schatten: Forscher vs. Hacker

Als die Botnetze Anfang 2026 eine kritische Masse erreichten, reichte es der IT-Sicherheits-Community. Die Experten der Black Lotus Labs (Lumen) entschlossen sich zu einem beispiellosen, proaktiven Gegenschlag.

Innerhalb von nur vier Monaten identifizierten und blockierten („Null-Routing“) die Forscher den Datenverkehr von sagenhaften 550 Command-and-Control (C2) Servern. Das glich dem Versuch, einem Kraken nach und nach alle Gehirne abzuschneiden. Jedes Mal, wenn die Botnetz-Betreiber ihre gekaperten Geräte für einen Angriff oder Betrug mobilisieren wollten, liefen ihre Befehle ins Leere.

Diese massive Störaktion brachte die Hintermänner ordentlich ins Schwitzen. Sie waren gezwungen, panisch neue Server-Architekturen aufzubauen und ihre Infrastruktur zu migrieren. Doch die Hacker reagierten nicht nur technisch. Sie nahmen es persönlich. In einem bizarren Racheakt richteten sie die verbleibende Feuerkraft ihrer Botnetze direkt gegen die Sicherheitsforscher. Die DDoS-Angriffe, die nun auf die Server der Experten einprasselten, enthielten eine besondere Botschaft: Der Schadcode war gespickt mit endlosen, vulgären Beschimpfungen, die direkt an die Forscher adressiert waren.

Hinter den kalten, automatisierten Angriffen von Millionen gekaperter Maschinen zeigten sich plötzlich die echten, wutentbrannten Gesichter frustrierter Krimineller, denen man gerade das lukrativste Geschäft ihres Lebens ruiniert hatte.

Das Endgame: Die globale Zerschlagung im März 2026

Doch die weitreichenden Bemühungen der privaten Sicherheitsforscher waren nur das Vorspiel für den ultimativen Todesstoß. Während die Betreiber der Botnetze noch damit beschäftigt waren, fluchend ihre Server vor den Forschern zu verstecken, zog sich die Schlinge der internationalen Strafverfolgungsbehörden bereits unwiderruflich zu.

Am 19. März 2026 endete die Schreckensherrschaft von Kimwolf und Aisuru in einem beispiellosen Polizeischlag. Das Bundeskriminalamt (BKA) und die Zentral- und Ansprechstelle Cybercrime Nordrhein-Westfalen (ZAC NRW) gaben bekannt, dass die Netzwerke in enger, international koordinierter Zusammenarbeit mit US-Behörden und kanadischen Ermittlern endgültig zerschlagen wurden. Den Behörden gelang es, die global verteilte Angriffs-Infrastruktur von Aisuru, Kimwolf sowie der eng verwobenen Schwesternetzwerke JackSkid und Mossad erfolgreich zu beschlagnahmen und vom Netz zu nehmen.

Ist Ihr Router ein Schläfer-Agent?

Die Geschichte von Kimwolf und Aisuru beweist eindrucksvoll: Cyberkrieg findet längst nicht mehr nur auf den Servern großer Konzerne statt. Das Schlachtfeld hat sich in unsere Wohnzimmer verlagert. Jedes schlecht gesicherte Gerät mit Internetzugang ist eine potenzielle Waffe in den Händen von Botnetz-Betreibern.

Der erfolgreiche Takedown durch die internationalen Ermittlungsbehörden war ein brillanter Etappensieg und ein deutliches Signal an Cyberkriminelle. Er zeigt, dass selbst die größten und aggressivsten Netzwerke nicht unantastbar sind. Doch der Kampf ist damit nicht vorbei. Die Zerschlagung von Kimwolf und Aisuru reißt ein Vakuum auf, das andere Akteure nur allzu gern füllen wollen.

Solange das Internet der Dinge von Sicherheitslücken geplagt ist und die Einstiegshürden für Cyberkriminelle dank KI-Tools weiter sinken, bleibt die Bedrohung bestehen. Es liegt nun an Herstellern, Unternehmen und gesamten IT-Sicherheitsbranche, aus den Taktiken der Botnetze zu lernen und die Schutzschilde für den nächsten, unweigerlich kommenden Sturm zu stärken.

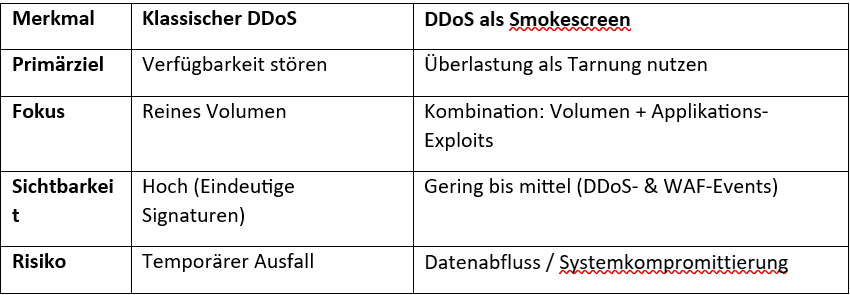

Nicht jede DDoS-Attacke verfolgt dasselbe Ziel. Manche sollen lediglich überlasten, andere sollen etwas verbergen. Ein massiver Anstieg der Request-Zahlen löst zwar in jedem SOC sofort Alarm aus, doch wenn innerhalb kürzester Zeit Millionen Anfragen auf die Infrastruktur einprasseln, greift die Standarddiagnose oft zu kurz.

Auf den ersten Blick scheint der Fall klar: ein klassischer DDoS-Angriff, der die Verfügbarkeit lahmlegen soll. Doch Vorsicht vor dem Offensichtlichen. Eine aktuelle Analyse von zwei verschiedenen Angriffsszenarien zeigt sehr deutlich, wie unterschiedlich die Motivation hinter scheinbar ähnlichem Traffic aussehen kann und warum genau dieser Unterschied für die Sicherheitsstrategie von entscheidender Bedeutung ist.

Während der eine Angriff lediglich „Lärm“ macht, nutzt der andere diesen Lärm als Tarnung für weitaus gefährlichere Operationen.

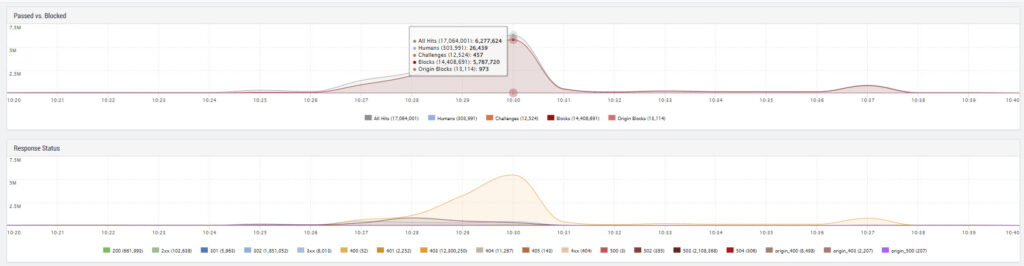

Fall 1: Der klassische DDoS-Angriff

Im ersten Szenario wurde ein Login-Bereich mit rund 17 Millionen Requests attackiert. Mehrere tausend IP-Adressen zielten dabei primär auf die Root-Domain.

Technisch betrachtet handelte es sich um einen „sauberen“, wenn auch massiven Volumenangriff.

Die forensischen Kennzahlen waren eindeutig:

- Reiner Traffic-Overload zur Ressourcenerschöpfung.

- Typische DDoS-Signaturen, die sofortige Rate-Limit-Trigger auslösten.

- Keine Hinweise auf SQL-Injection- oder Cross-Site-Scripting-Versuche (XSS).

Solche Attacken sind laut, hochgradig sichtbar und darauf ausgelegt, die Backend-Ressourcen zu binden oder gänzlich zu überfordern. Ohne vorgeschaltete Schutzmechanismen kann bereits ein Botnetz dieser Größe ausreichen, um kritische Anwendungen an ihre Belastungsgrenze zu bringen und massive Ausfälle zu verursachen.

Erfahren Sie mehr über eine einfach zu implementierende und äußerst effektive WAAP-Lösung.

Alles aus einer Hand und auf Wunsch als vollständig verwalteter Service.

Das ist die „klassische“ DDoS-Dynamik. Mit einer modernen WAAP-Plattform (Web Application & API Protection) bleibt der Effekt begrenzt: IP-Adressen werden automatisiert geblockt, Rate-Limits greifen präzise und der Angriff verpufft als gefiltertes Hintergrundrauschen.

Fall 2: DDoS als Ablenkungsmanöver

Das zweite Szenario verlief technisch ähnlich, war jedoch strategisch weitaus perfider. Hier gerieten zwei Domains, darunter eine hochfrequentierte Buchungsplattform, gleichzeitig ins Visier. Mit einem Volumen von 14 bis 40 Millionen Requests war die Intensität höher als im ersten Fall.

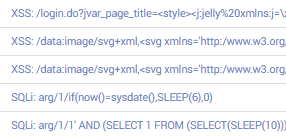

Die Analyse der Web Application Firewall (WAF) förderte jedoch ein gefährliches Zusatzmuster zutage: gezielte Signaturen für SQL-Injections und Cross-Site-Scripting (XSS).

Auszug aus der WAF-Analyse:

Dieses Muster lässt auf einen „Smokescreen“- Angriff schließen. Die dahinterstehende Logik ist so simpel wie gefährlich:

- Der „Lärm“: Ein massiver DDoS-Angriff erzeugt operative Hektik, flutet Monitoring-Systeme mit Alarmen und bläht Logfiles gigantisch auf.

- Die Tarnung: Im Windschatten dieses Rauschens versuchen Angreifer, leise und präzise Exploits zu platzieren, in der Hoffnung, dass diese in der Masse der Fehlermeldungen untergehen.

In diesem spezifischen Fall scheiterten die Angreifer jedoch an ihrer eigenen Ökonomie. Da sie für den volumetrischen DDoS und die Infiltrationsversuche dieselben IP-Adressen nutzten, waren diese bereits durch die DDoS-Schutzregeln blockiert, bevor die SQL- oder XSS-Versuche überhaupt eine Chance hatten.

Technisch war dieser Ansatz in seiner Ausführung zwar nicht sonderlich ausgereift, ein versierterer Akteur hätte getrennte Infrastrukturen und IP-Pools genutzt, doch die Absicht war eindeutig. Genau hier liegt der entscheidende Unterschied zum reinen Volumenangriff: Während bei Fall 1 die Störung im Vordergrund stand, zielte Fall 2 auf die Kompromittierung des Systems ab. Ein Risiko, das isolierte Sicherheitslösungen ohne korrelierende Intelligenz oft schutzlos zurücklässt.

Der strategische Unterschied

Hätte das Unternehmen im zweiten Fall lediglich einen isolierten DDoS-Schutz ohne verzahnte WAF-Intelligenz eingesetzt, wäre der „Rauch” zwar gefiltert worden, die feinen Nadelstiche der SQL-Injections hätten jedoch die Backend-Systeme erreichen können.

Die entscheidenden Faktoren waren:

- Automatisierte IP-Quarantäne: Eine IP, die durch DDoS-Muster auffällt, wird sofort global gesperrt.

- Übergreifende Reputation: Die Erkenntnis über eine bösartige IP auf Domain A schützt sofort Domain B.

- Ganzheitliche Sicht: Sicherheitsteams erkennen nicht nur den „Sturm“, sondern das gesamte Angriffsmuster.

Fazit

Nicht jeder Traffic-Peak ist ein reines Kapazitätsproblem. In einer hybriden Bedrohungslandschaft ist ein DDoS-Angriff häufig nur die Kulisse, hinter der sich ganz andere Vorgänge abspielen. Wer nur auf die Bandbreite schaut, übersieht das eigentliche Risiko. Resilienz bedeutet heute nicht nur, „online” zu bleiben, sondern Angriffe in ihrer Gesamtheit zu dekodieren.

Möchten Sie erfahren, wie eine moderne WAAP-Architektur DDoS- und Applikationsangriffe in Echtzeit korreliert und vollautomatisch stoppt? Erfahren Sie jetzt mehr über die ganzheitlichen Schutzlösungen von Link11.

Jetzt unsere Experten kontaktieren >>

Blogbeitrag von Dr. Georgia Papaioannou, Microsoft Deutschland

Cybersicherheit ist längst nicht mehr nur ein technisches Thema. Jedes Unternehmen kann potenziell Ziel von Angriffen werden, unabhängig von Branche oder Größe. Gleichzeitig werden die Bedrohungen immer komplexer: von Ransomware über Angriffe auf die Lieferkette bis hin zu politisch motivierten Hackeraktionen. Das bedeutet, dass Unternehmen Cybersecurity nicht nur operativ, sondern auch strategisch betrachten müssen. Nur so lässt sich IT-Sicherheit wirksam gestalten und in die Geschäftsstrategie integrieren.

Cybersecurity als strategisches Thema

IT-Sicherheit darf nicht isoliert betrachtet werden. Sie ist nicht nur ein Schutzinstrument für die IT-Abteilung, sondern ein strategischer Erfolgsfaktor für das gesamte Unternehmen. Sicherheitsmaßnahmen beeinflussen Geschäftsprozesse, den Ruf des Unternehmens und somit letztlich auch den wirtschaftlichen Erfolg.

Risiken in greifbare Zahlen übersetzen

Eine der größten Herausforderungen besteht darin, technische Bedrohungen in eine für die Unternehmensführung und Entscheidungsträger verständliche Sprache zu übersetzen. Fachbegriffe wie „Ransomware” oder „Zero-Day-Exploits” sind für das IT-Team relevant, für den Vorstand oder die Geschäftsleitung jedoch zum Teil noch unverständlich.

Hier ist eine datenbasierte, geschäftsorientierte Kommunikation entscheidend. Anstatt technischer Details sollten konkrete Szenarien aufgezeigt werden, wie beispielsweise: „Ein erfolgreicher Angriff könnte drei Tage Produktionsstillstand und einen Umsatzverlust von zwei Millionen Euro verursachen.“ Solche greifbaren Zahlen erzeugen Aufmerksamkeit und verdeutlichen die wirtschaftlichen Konsequenzen von Cyberrisiken.

Stakeholder-Management und bereichsübergreifende Zusammenarbeit

Cybersecurity betrifft alle Unternehmensbereiche – von der IT über die Personalabteilung bis hin zu Forschung und Entwicklung. Nur wenn diese Bereiche in die Strategie eingebunden werden, lassen sich Sicherheitsmaßnahmen effektiv umsetzen. Eine offene und verständliche Kommunikation schafft Vertrauen und ermöglicht die Bildung von Allianzen innerhalb des Unternehmens.

Erfolgreiche Sicherheitsverantwortliche verstehen sich als Enabler: Sie möchten dabei helfen, Risiken zu minimieren und Geschäftsziele zu erreichen. Dazu gehört nicht nur die Darstellung von Risiken, sondern auch die Begründung von Maßnahmen mit klaren Kennzahlen. KPIs und Risikoanalysen belegen, wie Security-Initiativen Unternehmensziele fördern, Kosten reduzieren und die digitale Transformation sichern.

Die Rolle von Business-orientierter Kommunikation

Technisches Wissen ist wichtig, reicht jedoch allein nicht aus. Entscheidend sind die Fähigkeiten, Risiken strategisch zu bewerten, ihre Eintrittswahrscheinlichkeit einzuschätzen und Kosten-Nutzen-Analysen durchzuführen. Die Ergebnisse müssen in einer verständlichen Sprache vermittelt werden, die nicht nur Fachleute, sondern auch das C-Level erreicht.

Eine zielgerichtete, businessorientierte Kommunikation erlaubt es, IT-Sicherheit als integralen Bestandteil der Unternehmensstrategie zu positionieren. Dadurch werden Sicherheitsmaßnahmen als Investition und nicht als Kostenfaktor wahrgenommen. So wird Cybersicherheit zum strategischen Vorteil und nicht nur zum Pflichtprogramm.

Prävention statt Reaktion

Ein zentrales Prinzip der Cybersicherheit lautet: Prävention ist effektiver und kostengünstiger als Reaktion. In vielen Unternehmen zeigt sich jedoch ein anderes Bild: Sicherheitsmaßnahmen werden oft erst dann ernsthaft umgesetzt, wenn bereits ein Vorfall eingetreten ist. Dies ähnelt der Situation in der Medizin, wenn Patienten erst zum Arzt gehen, wenn ihre Symptome ernst werden.

Prävention als kontinuierlicher Prozess

Prävention umfasst weit mehr als die einmalige Implementierung von Sicherheitssoftware. Es handelt sich um einen kontinuierlichen Prozess, der Awareness-Schulungen, regelmäßiges Monitoring, Incident Response, Forensik und die Dokumentation von Vorfällen einschließt. Ähnlich wie ein gut gepflegtes Immunsystem schützt sie das Unternehmen proaktiv vor Angriffen.

Awareness-Programme erhöhen das Bewusstsein der Mitarbeitenden für Risiken und fördern sicheres Verhalten. Monitoring und Logging ermöglichen die frühzeitige Erkennung von Anomalien, während Incident-Response- und Forensik-Prozesse sicherstellen, dass im Falle eines Angriffs schnell gehandelt werden kann. Die regelmäßige Dokumentation wiederum unterstützt die Nachverfolgung von Vorfällen und die Ableitung von Verbesserungsmaßnahmen.

Wirtschaftliche Effekte präventiver Maßnahmen

Prävention kostet zwar zunächst Ressourcen, ist aber langfristig deutlich günstiger als die Reaktion auf einen Sicherheitsvorfall. Ein erfolgreicher Cyberangriff kann nämlich Produktionsausfälle, Umsatzeinbußen, Reputationsschäden und rechtliche Konsequenzen nach sich ziehen. Die Kosten eines Angriffs übersteigen in der Regel die Investitionen in präventive Sicherheitsmaßnahmen um ein Vielfaches.

Mentalitätswandel in der Unternehmensführung

Neben technischen Maßnahmen erfordert Prävention vor allem einen Mentalitätswandel: IT-Sicherheit muss als fortlaufender strategischer Prozess verstanden werden, der Teil der Unternehmenskultur ist. Sicherheitsverantwortliche sollten nicht nur auf Vorfälle reagieren, sondern proaktiv die Resilienz des Unternehmens stärken.

Unternehmen, die IT-Sicherheit präventiv angehen, können Schwachstellen frühzeitig identifizieren, Risiken minimieren und die Widerstandsfähigkeit ihrer Prozesse erhöhen. Ein solcher Ansatz verändert die Sicht auf Cybersicherheit grundlegend: weg von der Kostenstelle, hin zu einem strategischen Schutzmechanismus, der Geschäftsziele absichert.

Fazit

Cybersecurity ist mehr als nur Technik: Es ist ein strategisches Thema, das alle Unternehmensbereiche betrifft. Erfolgreiche Sicherheitsstrategien verbinden technisches Wissen mit einer geschäftsorientierten Perspektive, übersetzen Risiken in greifbare Zahlen und bilden bereichsübergreifende Allianzen.

Prävention ist dabei der Schlüssel. Unternehmen, die frühzeitig handeln, Risiken kontinuierlich bewerten und Sicherheitsmaßnahmen als integralen Bestandteil ihrer Strategie verstehen, minimieren nicht nur Schäden, sondern schaffen auch Vertrauen bei Kunden, Partnern und Mitarbeitenden.

Cybersecurity ist kein einmaliges Projekt, sondern ein kontinuierlicher Prozess, ähnlich wie Gesundheitsvorsorge. Unternehmen, die dies erkennen, sind widerstandsfähiger, wirtschaftlich erfolgreicher und zukunftsfähiger.

Dr. Georgia Papaioannou

Dr. Georgia Papaioannou ist Security Specialist bei Microsoft Deutschland mit Fokus auf Cybersicherheit, Compliance und Identitätsmanagement. Sie ist als Mentorin aktiv und engagiert sich in Programmen wie She@ISACA und Women4Cyber Deutschland, um den Einstieg von Frauen in die IT-Sicherheit zu fördern.

Ein Gastbeitrag von Dr. Dominik Schürmann, Gründer & CEO von heylogin

Ich weiß nicht, wie oft ich in den letzten Jahren auf „Passwort vergessen?” geklickt habe. Vermutlich zu oft. Und ich bin mir sicher: Ich bin nicht allein.

Passwörter sind ein notwendiges Übel. Seit Jahrzehnten begleiten sie uns durchs Internet, obwohl wir alle wissen, dass sie alles andere als sicher sind. Menschen verwenden dieselben Passwörter auf zig Plattformen, notieren sie in Textdateien oder speichern sie unverschlüsselt im Browser. Und selbst wer alles richtig macht, ist nicht vor Datenlecks geschützt.

Ich habe viele Jahre in der IT-Sicherheitsforschung und an Lösungen für eine sichere Authentifizierung gearbeitet. Wenn ich eins gelernt habe, dann das: Das Problem liegt nicht beim Menschen, sondern im System. Und genau dieses System verändert sich dank Passkeys immer mehr.

Passkeys: Was steckt dahinter?

Passkeys sind kein neues Passwortformat, sondern basieren auf einem neuen Konzept. Im Kern ersetzen sie Passwörter durch ein kryptografisches Schlüsselpaar. Dieses Prinzip ist aus der modernen IT-Sicherheit bereits bekannt.

Das funktioniert so:

- Ein privater Schlüssel bleibt sicher auf dem Gerät des Nutzers, z. B. Smartphone oder Laptop.

- Ein öffentlicher Schlüssel wird auf der Website oder in der App gespeichert.

- Wenn sich jemand einloggt, signiert das Gerät eine einmalige Challenge. Es wird kein Passwort übertragen oder gespeichert.

Das bedeutet: Selbst wenn ein Server gehackt wird, gibt es dort kein Passwort, das gestohlen werden könnte. Und Phishing-Angriffe? Sie laufen ins Leere, da Passkeys nur für die echte Website funktionieren, nicht aber für eine täuschend ähnliche Kopie.

Kurz gesagt sind Passkeys sicherer und bequemer.

Warum Passkeys die bessere Lösung sind

Die klassische Passwortauthentifizierung hat zwei große Schwächen:

- Sie hängt vom Menschen ab. Wir sollen uns komplizierte, einzigartige Passwörter merken und sie regelmäßig ändern. Das widerspricht der menschlichen Natur.

- Sie macht uns angreifbar. Datenlecks, Passwort-Wiederverwendung, Social Engineering – Passwörter sind das schwächste Glied in der Sicherheitskette.

Passkeys lösen dieses Problem, da sie so konstruiert sind, dass sie menschliche Fehler kompensieren. Niemand muss sich etwas merken oder eingeben. Der Login erfolgt per Fingerabdruck-, Gesichtserkennung oder Geräte-PIN. Dabei werden keine biometrischen Daten in das Internet übertragen, sondern der Zugriff auf den benötigten Passkey lokal hergestellt.Das ist sicher, schnell und transparent.

Der Weg in die Praxis

Apple, Google und Microsoft wollen Passkeys weltweit etablieren. Das ist gut, gleichzeitig ein zweischneidiges Schwert. Denn wer Passkeys in den großen Ökosystemen anlegt, bindet sich zugleich an deren Infrastruktur. Die Schlüssel werden zwar sicher, aber zentral über iCloud, Google oder Microsoft-Konten synchronisiert.

Für viele Nutzer ist dies eine akzeptable Lösung. Gerade Unternehmen oder sicherheitsbewusste Privatpersonen wünschen sich jedoch mehr Unabhängigkeit. Anbieter wie heylogin entwickeln daher Lösungen, die eine datenschutzfreundliche und plattformunabhängige Nutzung von Passkeys ermöglichen. Denn eine Technologie, die Sicherheit bieten soll, darf keine neue Abhängigkeit schaffen.

Ich bin davon überzeugt, dass die Zukunft der Authentifizierung nicht allein den großen Plattformen gehören darf. Für die Entfaltung des vollen Potenzials von Passkeys sind offene Standards und vertrauenswürdige Alternativen unerlässlich.

Sicherheit braucht Vertrauen und Verständnis

Trotz der vielen Vorteile höre ich oft die Frage: „Das klingt alles schön, aber was ist, wenn ich mein Smartphone verliere?“

Eine berechtigte Frage. Doch auch hierfür sind Passkeys gut durchdacht. Die privaten Schlüssel werden in der Regel über mehrere Geräte hinweg synchronisiert und können über ein Backup-System wiederhergestellt werden. Bei einem sicheren Passwort-Manager, wie heylogin, läuft diese Synchronisation Ende-zu-Ende-verschlüsselt ohne dass der Betreiber des Passwort-Managers auf Passkeys zugreifen kann.

Ein weiterer Vorteil ist, dass Passkeys nicht nur sicherer, sondern auch bequemer sind. Es ist kein Eintippen, kein Copy-Paste und keine Codes per SMS mehr nötig. Ein Klick genügt und du bist eingeloggt.

In der Praxis führt diese Kombination aus Sicherheit und Komfort zu einem kulturellen Wandel: Sicherheit wird nicht mehr als Hürde empfunden, sondern als selbstverständlich integriert.

Der Mensch im Mittelpunkt

In der Sicherheitsforschung wird der Fokus häufig auf technische Aspekte gelegt. Dabei kommt die Bedeutung der Menschen als Teil des Sicherheitskontexts oftmals zu kurz. Doch am Ende geht es genau darum: Technologien zu entwickeln, die Menschen helfen, sicher zu handeln, ohne sie zu überfordern.

Passkeys bieten genau diese Möglichkeit. Sie entlasten den Nutzer von der Verantwortung für Komplexität, ohne ihm Kontrolle zu entziehen. Für mich ist dies der entscheidende Unterschied:

Gute Sicherheit ist unsichtbar und sie funktioniert einfach.

Ein Blick in die Zukunft

Wer heute Websites oder digitale Produkte entwickelt, sollte Passkeys nicht als Zukunftsthema betrachten. Große Plattformen wie PayPal, eBay, Google, GitHub und LinkedIn unterstützen sie bereits. In den kommenden Jahren wird das Passwort nach und nach an Bedeutung verlieren – es wird sich also nicht plötzlich, sondern schrittweise durch neue Verfahren und Technologien in der Kommunikation und im Internet verdrängen lassen.

Natürlich braucht dieser Wandel Zeit. Alte Systeme, konservative Infrastrukturen und das menschliche Bedürfnis nach Vertrautem bremsen den Fortschritt. Aber ich bin überzeugt: Die Richtung stimmt.

In ein paar Jahren werden wir uns vielleicht fragen, warum wir jemals Passwörter benutzt haben. So wie wir uns heute fragen, wie wir früher ohne Smartphones ausgekommen sind.

Fazit

Die Zukunft der digitalen Sicherheit ist passwortlos. Passkeys sind keine kurzlebige Modeerscheinung, sondern eine logische Weiterentwicklung. Sie machen das Internet sicherer und das Leben einfacher.

Ich wünsche mir, dass wir diese Entwicklung bewusst gestalten: offen, datenschutzfreundlich und benutzerzentriert. Denn Technologie allein reicht nicht aus. Sie braucht Vertrauen. Und Vertrauen entsteht, wenn Sicherheit sich wie Komfort anfühlt, nicht wie Kontrolle.

Über den Autor

Dr. Dominik Schürmann ist Gründer & CEO von heylogin und Experte für IT-Sicherheitsarchitekturen und benutzerfreundliche Authentifizierungslösungen. Er beschäftigt sich seit vielen Jahren mit der Schnittstelle zwischen Kryptografie, Datenschutz und User Experience.

Wir haben bereits geklärt, dass WAAP die logische Antwort auf moderne Anwendungsarchitekturen ist. Doch was bedeutet das in der Praxis? Wenn wir die Theorie beiseitelegen, geht es bei WAAP vor allem darum, Sicherheit skalierbar und beherrschbar zu machen.

Im Folgenden stellen wir Ihnen die vier entscheidenden Wege vor, wie WAAP Ihnen dabei hilft, die Kontrolle über Ihre digitale Infrastruktur zurückzugewinnen.

Die Rückkehr der Sichtbarkeit

Der erste praktische Mehrwert von WAAP zeigt sich dort, wo die klassische Web Application Firewall (WAF) an ihre Grenzen stößt: bei der Angriffsfläche selbst. Eine herkömmliche WAF prüft einzelne Requests gegen starre Regeln. Das ist effektiv gegen bekannte Muster, für verteilte Systeme jedoch unzureichend.

WAAP setzt früher an und betrachtet Web-Anwendungen und APIs als zusammenhängendes System.

- Kontextsicht: Es entsteht erstmals wieder Transparenz darüber, welche Schnittstellen überhaupt existieren (Stichwort: Shadow APIs).

- Verhaltensanalyse: WAAP erkennt, was innerhalb einer spezifischen Anwendung „normal” ist. Allein diese Sichtbarkeit ist für viele Organisationen der wichtigste Schritt, um vom reaktiven Modus in eine proaktive Gestaltung zu gelangen.

Erfahren Sie mehr über eine unkompliziert zu implementierende und hocheffektive Lösung. Alles aus einer Hand und auf Wunsch als Fully Managed Service.

Infrastruktur-Entlastung: Sicherheit ohne Performance-Verlust

Moderne Angriffe sind nicht nur raffinierter, sondern auch „lauter”. Bots, Scraper und DDoS-Attacken auf Anwendungsebene erzeugen eine enorme Last, durch die lokale Gateways oft bereits vor dem Eingreifen eines Filters in die Knie gehen.

WAAP-Plattformen sind in der Regel Cloud-nativ aufgebaut und fungieren daher als Schutzschild am Rand des Netzes (Edge). Rechenintensive Aufgaben wie,

- TLS-Entschlüsselung

- Korrelation globaler Signale und

- komplexe Verhaltensanalysen

wandern in die skalierbare Plattform des Providers.

Für Betreiber bedeutet das weniger Druck auf die eigenen Systeme und das Ende des Kompromisses zwischen maximaler Sicherheit und optimaler Performance.

- Vorteil für Admins: Ihre Server sehen nur noch „sauberen“ Traffic.

- Vorteil für Entscheider: Sie müssen Ihre lokale Infrastruktur nicht für Traffic-Spitzen oder DDoS-Attacken überdimensionieren, da die Cloud diese Last abfängt.

Intelligentere Entscheidungen

Der entscheidende Unterschied liegt darin, wie WAAP über Blockade oder Durchlass entscheidet. Anstatt sich nur auf „Blacklists“ zu verlassen, kombiniert die Plattform verschiedene Signale wie API-Strukturen, Bot-Fingerprints, Reputationsdaten und Verhaltensanomalien.

Bei klassischen Angriffen werden technische Lücken ausgenutzt, wie zum Beispiel SQL-Injections. Moderne Angreifer nutzen jedoch oft die Logik der Anwendung selbst aus, beispielsweise durch das automatisierte Ausprobieren von Rabattcodes oder das massive Abfragen von Lagerbeständen.

WAAP-Lösungen korrelieren Signale über längere Zeiträume und helfen so, Angriffe zu erkennen. Wenn ein Client ungewöhnlich viele Abfragen in einer bestimmten Reihenfolge tätigt, schlägt das System Alarm, auch wenn jeder einzelne Request für sich genommen „legal” aussieht. Diesen kontextuellen Schutz kann eine punktuell arbeitende WAF strukturell nicht leisten.

Der Unterschied liegt vor allem in der Flexibilität. Eine klassische Web Application Firewall (WAF) arbeitet mit festen Regeln, die definieren, was erlaubt oder verdächtig ist. Eine WAAP-Plattform ergänzt diesen Ansatz um Kontext- und Verhaltensanalyse und kann dadurch flexibler zwischen legitimer Nutzung und Missbrauch unterscheiden. Dadurch wird der Aufwand für manuelles Nachjustieren reduziert und der Schutz insgesamt anpassungsfähiger gemacht.

Die unsichtbare Schwachstelle absichern

Gerade bei APIs zeigt sich die strukturelle Überlegenheit. Sie haben klar definierte Strukturen und Logiken, die ein einfacher HTTP-Filter nicht versteht. WAAP kann diese Schemata validieren und Abweichungen in Echtzeit stoppen. Dies ist ein Schutzlevel, das Unternehmen heute dringend benötigen, da APIs zunehmend zum primären Ziel für Datendiebstahl werden.

Skalierbarkeit als Zielbild

Organisatorisch hilft WAAP dabei, Komplexität zu reduzieren. Anstatt mühsam Einzellösungen für WAF, Bot-Schutz, API-Security und DDoS-Abwehr zu orchestrieren, bündelt die Web Application & API Protection (WAAP) diese Funktionen in einer gemeinsamen Schutzschicht.

Der eigentliche Mehrwert von WAAP besteht somit nicht nur im Blockieren von Angriffen. Es ist die Transformation der Anwendungssicherheit in ein Modell, das mit der Dynamik von APIs und Automatisierung mithalten kann. Für Organisationen, die ihre digitale Wertschöpfung skalieren wollen, ist WAAP somit keine nette Zusatzfunktion, sondern eine notwendige Basis.