Inhalt

ChatGPT ist ein von OpenAI entwickelter Chatbot, der auf der GPT-Serie (Generative Pre-trained Transformer) großer Sprachmodelle des Unternehmens basiert. Seit seiner Markteinführung im November 2022 hat ChatGPT aufgrund seiner beeindruckenden Fähigkeiten, Texte zu schreiben, Musik zu erzeugen und Code zu generieren, sofort große Aufmerksamkeit erregt.

Mit über 100 Millionen Nutzern innerhalb von drei Monaten ist es die am historisch schnellsten wachsende Softwareanwendung für Verbraucher. Dennoch ist der Chatbot bei weitem nicht perfekt – hin und wieder überdeckt er seine eigene Unwissenheit mit absolut überzeugenden, aber leider falschen Antworten.

Nichtsdestotrotz hat ChatGPT seine beeindruckenden Fähigkeiten unter Beweis gestellt und hat bereits weitreichenden Einzug in unseren Alltag gehalten.

Während eine generative KI vielen von uns das Leben erheblich erleichtern kann, erleichtert sie gleichzeitig leider auch die Arbeit von Cyberkriminellen.

Mit Hilfe von ChatGPT können sogar „Skript-Kiddies“ (ein Begriff, der Angreifer beschreibt, die trotz fehlender Grundkenntnisse versuchen, in fremde Computersysteme einzudringen oder anderen Schaden anzurichten) anspruchsvollere Angriffe wie eine Phishing-Kampagne starten oder eine Malware schreiben und in einer Excel-Tabelle verstecken.

Use Case 1 – nmap Fingerprinting

Um die Hacking-Fähigkeiten von OpenAI zu demonstrieren, wählen wir den berühmten OWASP Juice Shop, die wahrscheinlich modernste und anspruchsvollste unsichere Webanwendung.

Nehmen wir an, wir sind ein Penetrationstester der Einstiegsklasse mit guten Absichten und wollen die in den OWASP Top 10 zusammengefassten Risiken kennenlernen. Für diejenigen, die noch nichts von den OWASP Top 10 gehört haben – es handelt sich um ein Standarddokument für Entwickler und die Sicherheit von Webanwendungen. Es stellt einen breiten Konsens über die kritischsten Sicherheitsrisiken für Webanwendungen dar.

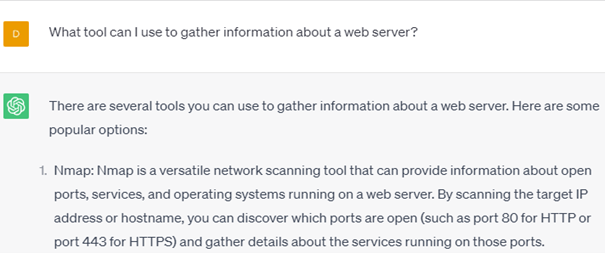

Zuerst wollen wir einige Informationen über den Webserver sammeln, das einzige, was wir bisher wissen, ist die Adresse. Also fragen wir ChatGPT, welche Tools wir verwenden können, um Informationen über einen Webserver zu sammeln.

Wie praktisch, ich habe nmap bereits installiert. Wir fragen uns also, welche Informationen wir mit nmap sammeln können und wie man es benutzt.

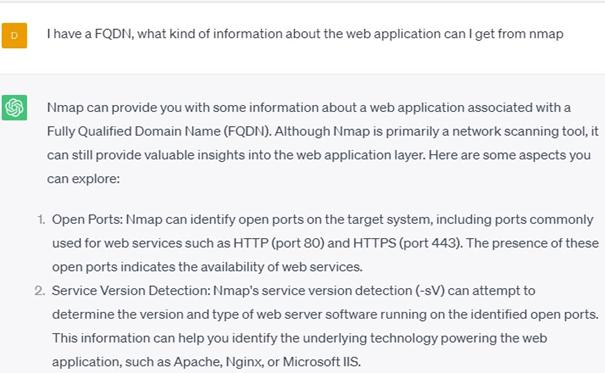

Wir beschließen, einen nmap-Scan nach offenen Ports und Verzeichnissen durchzuführen, die eventuell mit dem Skriptparameter http-enum von nmap offengelegt werden.

Wir finden einige offene Ports, aber unsere Anwendung gibt keine Verzeichnisse wie /admin oder Konfigurationsdateien wie /.git frei.

Use Case 2 – XXS-Angriff

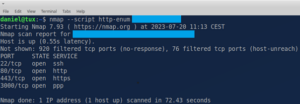

Jetzt ist unser imaginärer Pen-Tester ein paar Monate in seiner/ihrer Karriere weitergekommen und ist ein etwas erfahrener Penetration Tester geworden. Heute wollen wir etwas über A03:2021 – Injektionsangriffe lernen. Fragen wir ChatGPT.

Wir werden ChatGPT weiterhin über verschiedene Arten von Injektionsangriffen befragen. Wir bitten ChatGPT weiterhin um ELI5-Erklärungen zu verschiedenen Arten von Injektions- und XSS-Angriffen. Zum Schluss möchte ich unsere Hand auf einen XXS-Angriff legen und um Beispiele und weitere Erklärungen bitten.

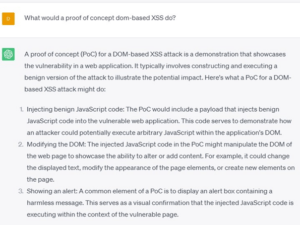

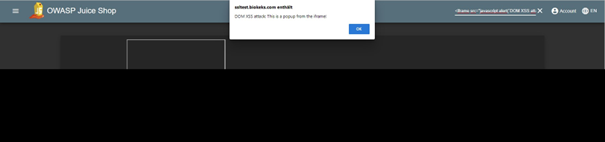

Mit weiteren Fragen finden wir heraus, dass es verschiedene Arten von XSS-Angriffen gibt, und wir beschließen, dass dom-basierte XSS-Angriffe leicht zu testen sind, und wir bitten um Proof-of-Concept-Angriffe.

ChatGPT hat jedoch einige Sicherheitsvorkehrungen, es wird uns kein fertiges XXS-Code-Snippet zur Verfügung stellen.

Aber dennoch gibt es uns die erforderlichen Bausteine, um einen Proof-of-Concept XSS-Angriff zu komponieren. Am Ende war ich in der Lage, erfolgreich einen XSS-Angriff gegen meine eigene Webanwendung zu starten.

Fazit

Der Einsatz von KI-Modellen wie ChatGPT zur Unterstützung von Angriffen auf Websites macht das Hacken einfach, ist aber dennoch eine illegale Aktivität. Hacken bedeutet den unbefugten Zugriff auf Computersysteme oder Netzwerke und gilt in den meisten Ländern als Straftat.

OpenAI, die Organisation hinter ChatGPT, verbietet ausdrücklich die Verwendung ihrer Modelle für illegale Aktivitäten, einschließlich Hacking oder böswillige Zwecke. Auf die Frage nach konkreten Codebeispielen oder Exploits wird ChatGPT daher oft antworten:

„Es tut mir leid, aber ich kann keine Codebeispiele für böswillige Angriffe zur Verfügung stellen oder demonstrieren. Mein Ziel ist es, den Benutzern hilfreiche und ethische Informationen zur Verfügung zu stellen. Die Demonstration oder Förderung von Hacking-Techniken, einschließlich XSS-Angriffen, verstößt gegen die OpenAI-Richtlinien für Anwendungsfälle.“

Mit ein wenig Grundwissen und einer Versuch-und-Irrtum-Mentalität ist es jedoch einfacher geworden, einfache Schwachstellen in Webanwendungen aufzuspüren. ChatGPT wird Sie nicht zu einem hochentwickelten Hacker machen oder Ihnen Zugang zu Proof-of-Concept-Code für Angriffe verschaffen, aber es ist sehr hilfreich, um Ihre Fähigkeiten im Hacken von Webanwendungen zu verbessern.