Bei einem großen europäischen E-Commerce-Anbieter beobachteten unsere Analysten für unseren Cyber Insight im Januar ein ungewöhnliches Angriffsmuster. Es handelte sich nicht um eine klassische DDoS-Attacke mit massivem Traffic-Volumen. Stattdessen zeigte sich über mehrere Wochen hinweg ein subtiler, wiederkehrender Lastanstieg, der den Webshop montags spürbar verlangsamte.

Dieser Fall ist exemplarisch für eine neue Generation von Angriffen, bei denen infizierte Endgeräte mit legitimen Browsern eingesetzt werden, um Serverressourcen gezielt zu erschöpfen. Es gab keinen plötzlichen Peak und keinen Alarm im Backbone, sondern ein leises, systematisches Ausbremsen einer produktiven Plattform.

Ein Muster, das nicht zum Geschäft passte

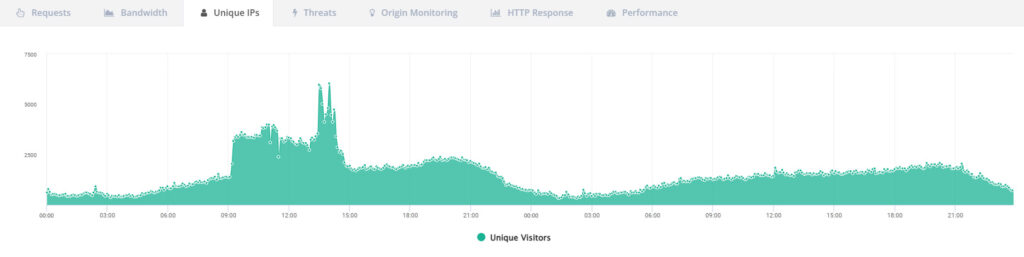

An normalen Tagen bewegte sich die Zahl der eindeutigen IP-Adressen stabil unter 2.000, an mehreren Montagen jedoch verdoppelte sie sich regelmäßig auf 4.000 bis 6.000.

Zunächst wirkte dies wie eine harmlose Verkehrsschwankung. Eine Überprüfung der Geschäftsaktivitäten ergab jedoch ein klares Bild: Es gab keine Kampagnen, keine Newsletter, keine besonderen Angebote und auch keine erhöhte Social-Media-Aktivität.

Kurz gesagt: Es gab keinen legitimen Grund für diesen wiederkehrenden Anstieg.

Auffällig war vor allem die Regelmäßigkeit. Der Effekt trat ausschließlich montags auf, Woche für Woche, und verschwand an allen anderen Tagen vollständig. Dieses zeitliche Muster allein war ungewöhnlich genug, um eine tiefere Analyse auszulösen.

Wenig Traffic, große Wirkung

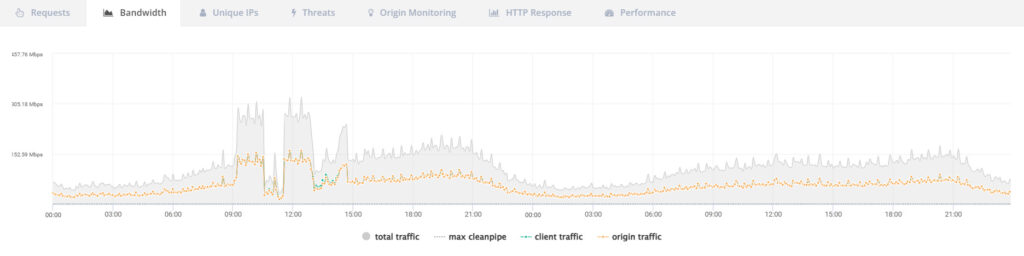

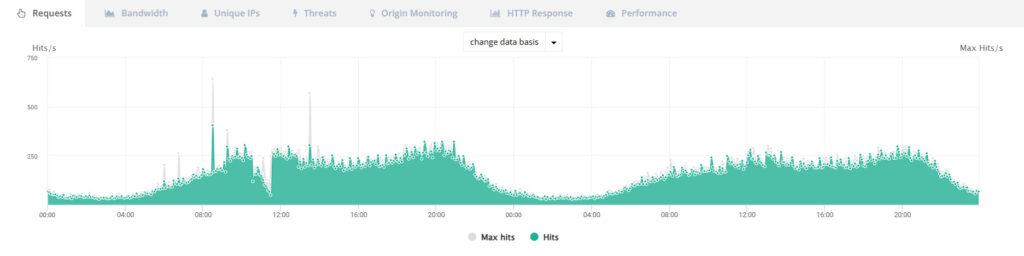

Auf den ersten Blick wirkten die technischen Metriken unauffällig. Weder die Bandbreite noch die Requests pro Sekunde sprangen ins Auge.

Erst bei genauerer Betrachtung zeigte sich das eigentliche Problem.

Die Last verteilte sich auf sehr viele Quellen, von denen jede einzelne nur minimal aktiv war. Charakteristisch war dabei:

- nur ein bis zwei Requests pro IP

- viele Verbindungen blieben ungewöhnlich lange offen.

- kaum gleichzeitige Peaks, sondern gleichmäßige Dauerlast.

- kaum Schwankungen in den klassischen Volumenmetriken.

In der Summe entstand somit kein klassischer Angriff, sondern ein schleichender Ressourcenverbrauch. CPU, Speicher und Connection-Handling der Origin-Server liefen zunehmend am Limit.

Die messbare Folge waren Response-Zeiten von unter 200 Millisekunden, die an den betroffenen Montagen auf mehrere Sekunden anstiegen. Für einen Webshop bedeutete dies langsame Seiten, abbrechende Warenkörbe und sinkende Konversionsraten, ohne dass es einen klaren Auslöser gab.

Wenn Schutzsysteme nichts sehen

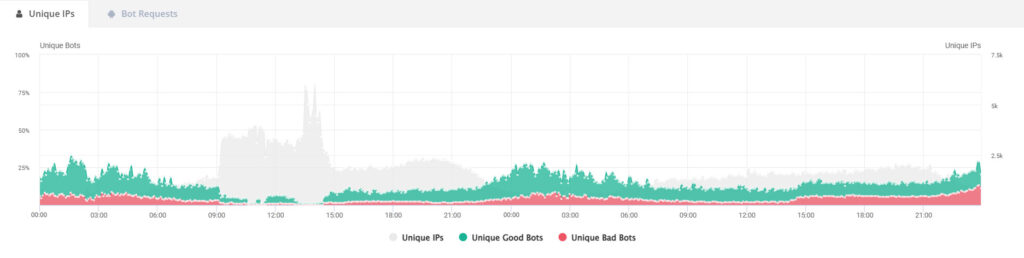

Besonders kritisch war, dass das bestehende Bot-Management den Traffic nahezu vollständig als legitim einstufte. Es gab weder auffällige User-Agents noch ungewöhnliche Request-Sequenzen oder verdächtige Protokollfehler. Auch die Herkunft der Anfragen wirkte harmlos.

Der Großteil des Traffics kam aus Deutschland aus typischen Endkunden-Netzen großer Consumer-Provider. Weder Geo-Blocking noch ASN-Blocking oder IP-Reputationsfilter lieferten brauchbare Ansatzpunkte.

Alles deutete darauf hin, dass hier keine klassischen Server-Bots, sondern echte, kompromittierte Endgeräte mit vollwertigen Browsern arbeiteten. Jedes einzelne Gerät verhielt sich fast unauffällig. Erst die Masse machte den Angriff wirksam.

Low-and-Slow mit realen Clients

Das Muster passte zu einem klassischen Low-and-Slow-Angriff. Es gab viele Quellen, geringe Aktivität pro Quelle, ein technisch sauberes Protokollverhalten und einen klaren Fokus auf offene Verbindungen statt auf Bandbreite.

Solche Angriffe sind besonders gefährlich, da sie sich im statistischen Rauschen der normalen Nutzeraktivität verstecken. Sie lösen keine klassischen Schwellenwerte aus und umgehen signaturbasierte Erkennung nahezu vollständig.

Hinzu kam die merkwürdige zeitliche Begrenzung auf einen einzigen Wochentag. Warum der Angriff ausschließlich montags stattfand, ließ sich nicht eindeutig klären. In Frage kommen unter anderem:

- automatisierte Testläufe eines Botnetzes

- Trainingsphasen vor größeren Kampagnen.

- gezielte Belastungstests der Infrastruktur.

- vorbereitende Reconnaissance.

Erfahren Sie mehr über eine DSGVO-konforme, cloud-basierte und patentierte DDoS Protection, die hält, was sie verspricht.

Ein einfacher Test mit großer Wirkung

Nachdem alle klassischen Analyse- und Filtermechanismen ausgeschöpft waren, blieb nur noch eine Option: die Aktivierung einer globalen CAPTCHA-Defense.

Der Kunde zögerte zunächst. Seine Sorge vor negativer User Experience war berechtigt. In einem kontrollierten Test wurde die Maßnahme dennoch aktiviert.

Die Wirkung zeigte sich innerhalb von Sekunden:

- deutlicher Rückgang der Last auf den Origin-Servern.

- Normalisierung der Response-Zeiten

- über 99 Prozent der auffälligen Anfragen wurden blockiert.

Der Webshop lief wieder stabil, ohne nennenswerten Einfluss auf echte Nutzer. Damit war klar: Trotz legitimer Clients handelte es sich um automatisierte Prozesse.

Was dieser Angriff lehrt

Dieser Vorfall verdeutlicht mehrere zentrale Entwicklungen moderner Angriffe.

- Nicht das Volumen, sondern die Präzision entscheidet.

- Echte Geräte werden zunehmend zur Angriffsplattform.

- Klassisches Bot-Management reicht bei sauberem Traffic nicht aus.

- Mensch-Maschine-Checks bleiben ein wirksames Instrument.

Low-and-Slow-Angriffe zeigen, wie leicht sich moderne Infrastrukturen unterhalb klassischer Alarmgrenzen ausbremsen lassen.

Moderne Abwehr statt reaktiver Notlösungen

In der eingesetzten Sicherheitsarchitektur war CAPTCHA der letzte verfügbare Hebel. Auf modernen Web-Application-Protection-Plattformen lassen sich solche Angriffe deutlich eleganter abwehren.

Anstelle von expliziten Captchas kommen dort unter anderem verhaltensbasierte Verfahren zum Einsatz: JavaScript-Challenges im Hintergrund, Headless-Browser-Erkennung, Browser-Fingerprinting und die Korrelation von Sessions über längere Zeiträume. Für echte Nutzer bleiben diese Mechanismen unsichtbar, kompromittierte Clients scheitern hingegen zuverlässig.

Neue Realität im Bot-Zeitalter

Wer heute nur auf Volumen, Signaturen und klassische Bots achtet, übersieht genau diese Art von Angriff. Eine moderne Abwehr erfordert ein Zusammenspiel aus Verhaltensanalyse, Human-Verifikation und feingranularer Traffic-Steuerung.

Für IT-Entscheider bedeutet das vor allem eines: Anomalien in der Zahl der Unique IPs sind kein Randphänomen, sondern oft das früheste Warnsignal für eine stille, aber wirksame Attacke.

Wenn auch Ihre Webanwendungen unter unerklärlichen Lastspitzen, steigenden Latenzen oder verdächtigen Zugriffsmustern leiden, unterstützen wir Sie gerne bei der Analyse und Absicherung Ihrer Infrastruktur.

Sprechen Sie uns an – bevor aus einer stillen Anomalie ein echter Ausfall wird!

Lisa Fröhlich

Lisa Fröhlich